인공 신경망의 추론처리 특징부터 구현까지 - 딥러닝 정리

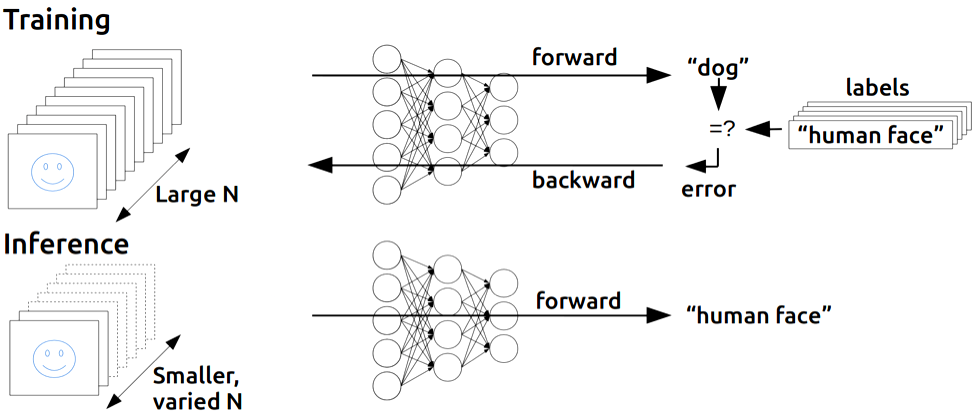

목차 개요 신경망의 추론 처리는 훈련된 모델을 사용하여 보이지 않는 새로운 데이터를 예측하는 프로세스입니다. 학습된 모델은 학습 프로세스 중에 학습한 패턴 및 관계를 기반으로 입력 데이터에 대한 예측 또는 추론을 수행하는 데 사용됩니다. 특징 추론 처리는 기계 학습 파이프라인의 마지막 단계이며 모델을 실제 응용 프로그램에 배포할 수 있도록 합니다. 계산 리소스가 덜 필요하고 더 빠르게 수행할 수 있다는 점에서 훈련과 다릅니다. 그러나 예측의 품질은 교육의 품질에 따라 달라집니다. 추론에는 온라인과 오프라인의 두 가지 주요 유형이 있습니다. 온라인 추론은 자율 주행 자동차 또는 음성 인식과 같이 모델이 가능한 한 빨리 예측을 수행해야 하는 실시간 애플리케이션에 사용됩니다. 오프라인 추론은 데이터 세트의 이..